Tôi chưa bao giờ thực sự thoải mái khi sử dụng các mô hình ngôn ngữ lớn (LLM) dựa trên đám mây. Hầu hết chúng yêu cầu gửi dữ liệu cá nhân của bạn đến các máy chủ từ xa, điều này làm dấy lên những lo ngại rõ ràng về quyền riêng tư. Hơn nữa, nhiều công cụ AI bị khóa sau các gói đăng ký đắt đỏ và bạn có rất ít quyền kiểm soát cách chúng hoạt động. Với tốc độ cải thiện nhanh chóng của các mô hình AI cục bộ, tôi muốn tìm hiểu xem liệu việc tự chạy LLM tại nhà có còn là điều viển vông hay không. Có nhiều lý do để bạn thử tự host LLM, vì vậy tôi đã quyết định thử và thực sự rất ngạc nhiên về những gì mình đã đạt được.

Thông báo động từ Home Assistant với dự báo thời tiết được tạo bởi LLM cục bộ

Thông báo động từ Home Assistant với dự báo thời tiết được tạo bởi LLM cục bộ

Ollama: Cổng Mở Đến Thế Giới LLM Cục Bộ Dễ Dàng

Đơn giản đến bất ngờ, ngay cả với người mới

Đối với thiết lập của mình, tôi đã sử dụng Ollama làm công cụ cốt lõi để chạy các mô hình ngôn ngữ. Nếu bạn chưa từng nghe về nó, Ollama là một framework gọn nhẹ được thiết kế để giúp việc chạy các mô hình ngôn ngữ lớn cục bộ trở nên dễ tiếp cận hơn rất nhiều. Nó xử lý toàn bộ quá trình, từ việc tải xuống các tệp mô hình cho đến thiết lập môi trường chạy và quản lý tài nguyên phần cứng.

Bạn có thể chạy các mô hình chỉ với vài lệnh terminal mà không cần phải tự mình xử lý tất cả các cấu hình backend phức tạp thường đi kèm với các LLM cục bộ. Ollama hoạt động hoàn toàn trên máy tính của bạn, vì vậy các mô hình và dữ liệu đều được giữ cục bộ. Nó hỗ trợ hầu hết các mô hình mã nguồn mở như DeepSeek, LLaMA và nhiều mô hình khác, thậm chí bạn có thể tải mô hình riêng của mình nếu muốn. Ollama cũng tự động xử lý các tối ưu hóa để đảm bảo các mô hình chạy hiệu quả dựa trên phần cứng của bạn.

Mặc dù Ollama bản thân không được đóng gói trong container theo mặc định, tôi đã chạy toàn bộ hệ thống bên trong Docker để giữ mọi thứ cô lập và dễ quản lý hơn. Điều đó cũng giúp thiết lập trở nên di động và tránh mọi xung đột với các phụ thuộc khác trên hệ thống của tôi.

Đối với giao diện người dùng, tôi đã kết hợp Ollama với Open WebUI. Đây là một frontend web mã nguồn mở kết nối trực tiếp với API của Ollama, cung cấp một giao diện trò chuyện rõ ràng để tương tác với các mô hình của bạn. Tôi đã để lộ thiết lập này bằng Ngrok để có thể truy cập an toàn từ xa, trong khi Open WebUI cũng xử lý xác thực cơ bản để giữ mọi thứ được bảo mật.

Logo chính thức của Ollama, nền tảng chạy LLM cục bộ

Logo chính thức của Ollama, nền tảng chạy LLM cục bộ

Ollama là một nền tảng để tải xuống và chạy các mô hình ngôn ngữ lớn (LLM) mã nguồn mở khác nhau trên máy tính của bạn.

Hiệu Suất Bất Ngờ: LLM Cục Bộ Hoạt Động Mượt Mà Hơn Mong Đợi

Không ngờ AI cục bộ lại “mượt” đến thế

Bước đầu tiên là chọn mô hình phù hợp, và tôi đã chọn mô hình DeepSeek R1 với 7 tỷ tham số (7B parameter). Tôi đang chạy mọi thứ trên một chiếc MacBook Air với chip M1 và 16GB bộ nhớ hợp nhất. Rõ ràng đây không phải là một cỗ máy được xây dựng cho các tác vụ AI nặng, nhưng tôi đã ngạc nhiên về khả năng xử lý của nó.

Miễn là tôi giữ cho LLM chạy một mình, nó hoạt động hoàn toàn ổn định. Nó chỉ bắt đầu chậm lại nếu tôi cố gắng thực hiện các tác vụ khác trên máy Mac trong khi mô hình đang chạy. Thành thật mà nói, tôi đã nghĩ rằng toàn bộ quá trình sẽ là một thảm họa. Chạy LLM là một trong những tác vụ đòi hỏi nhiều tài nguyên nhất mà bạn có thể thực hiện trên phần cứng tiêu dùng. Nhưng vì tôi chỉ sử dụng mô hình 7B, nó vẫn có thể quản lý được ngay cả trên chiếc MacBook của mình.

Nói một cách đơn giản, “7B” có nghĩa là mô hình có khoảng 7 tỷ tham số. Bạn có thể hình dung các tham số như những cài đặt hoặc chỉ dẫn nhỏ bên trong mô hình giúp nó hiểu ngôn ngữ, tạo phản hồi hoặc giải quyết vấn đề. Mô hình càng có nhiều tham số thì khả năng của nó càng tiên tiến, nhưng điều đó cũng đồng nghĩa với việc bạn cần phần cứng mạnh mẽ hơn để chạy nó. Bảy tỷ nghe có vẻ rất nhiều, nhưng nó được coi là một trong những mô hình nhẹ hơn, hiệu quả hơn mà vẫn hoạt động tốt cho các tác vụ hữu ích.

Ngay cả với những hạn chế đó, mô hình đã xử lý các yêu cầu đơn giản mà không gặp vấn đề gì. Tôi đã sử dụng nó để gỡ lỗi các đoạn mã cơ bản trong các chuyến bay và cho các tác vụ ngoại tuyến nhanh chóng. Nếu bạn có phần cứng mạnh hơn, bạn có thể vượt qua mức 7B và chạy các mô hình lớn hơn như 32B hoặc thậm chí 70B tham số, có khả năng xử lý các yêu cầu phức tạp hơn với lý luận và độ chính xác cao hơn.

Nhưng ngay cả với một thiết lập khiêm tốn, việc chạy LLM cục bộ hóa ra lại cực kỳ thiết thực một cách đáng ngạc nhiên. Nếu bạn không hài lòng với việc chỉ chạy một LLM, bạn có thể thử biến chiếc PC cũ của mình thành một máy chủ AI hoàn chỉnh cho các tác vụ khác.

Bên trong hộp Home Assistant Voice PE, giải pháp nhà thông minh tích hợp LLM

Bên trong hộp Home Assistant Voice PE, giải pháp nhà thông minh tích hợp LLM

Chưa Hoàn Toàn Thay Thế ChatGPT, Nhưng Vẫn Rất Giá Trị

Khi nào cần đến đám mây, khi nào local lên ngôi

Mặc dù tôi rất thích thú khi chạy LLM cục bộ, nhưng nó chưa hoàn toàn thay thế các công cụ như ChatGPT đối với tôi. Tôi chủ yếu sử dụng thiết lập cục bộ của mình cho các tác vụ nhẹ hơn hoặc khi tôi không có kết nối internet, chẳng hạn như khi tôi đang đi du lịch. Đối với các sửa lỗi mã nhanh, bản nháp hoặc các yêu cầu đơn giản, mô hình 7B hoạt động khá tốt, và thành thật mà nói, nó là quá đủ cho hầu hết các tác vụ liên quan đến LLM của tôi. Tuy nhiên, vẫn có những tình huống tôi yêu cầu hiệu suất, độ chính xác hoặc chuyên môn cao hơn mà các mô hình đám mây cung cấp, và đó là lúc tôi chuyển sang sử dụng ChatGPT hoặc các công cụ tương tự.

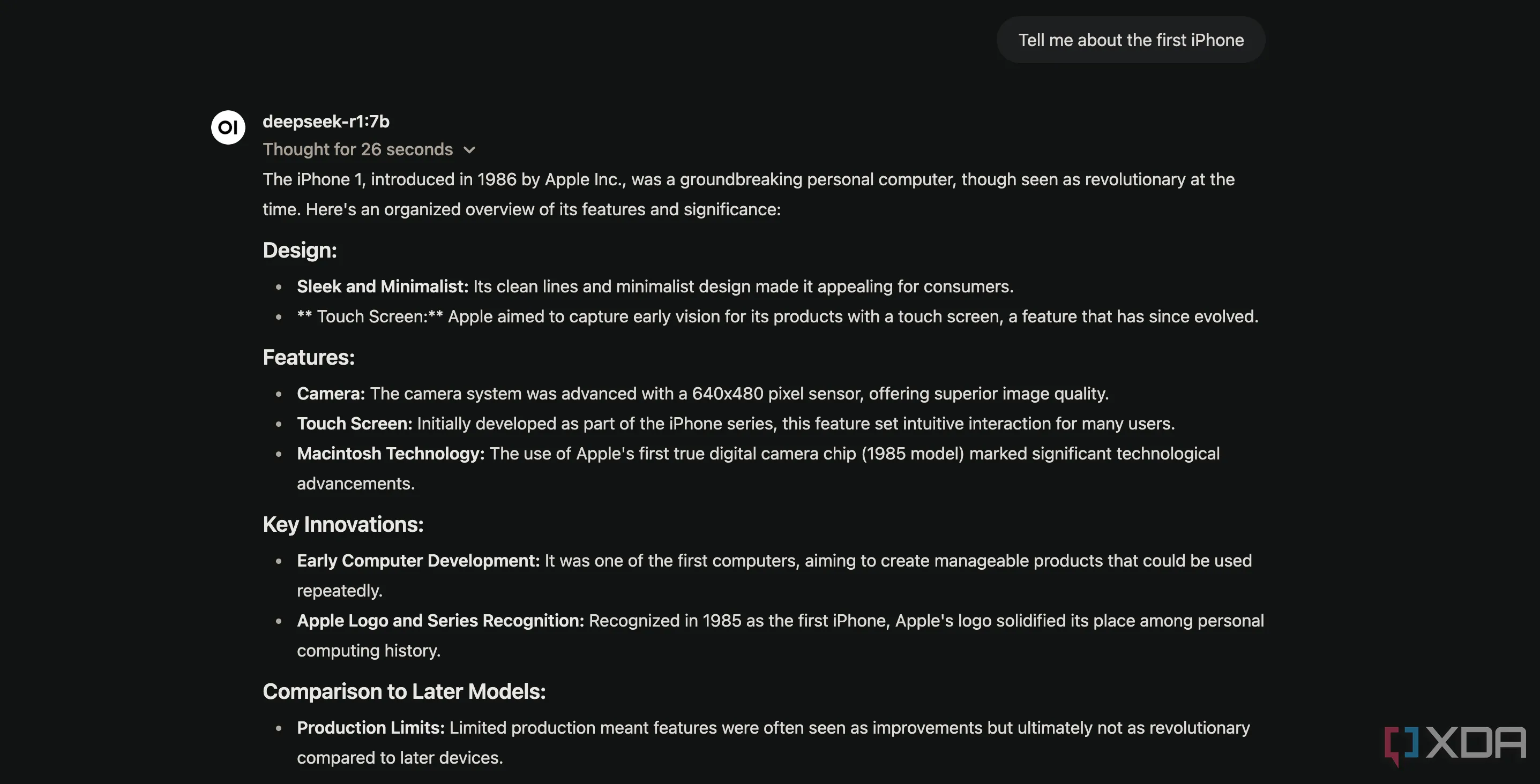

Ví dụ, tôi đã hỏi DeepSeek R1 về chiếc iPhone đầu tiên, và nó đã đưa ra một câu trả lời sai đến mức buồn cười. Nó khẳng định rằng chiếc iPhone nguyên bản ra mắt vào năm 1986, điều này rõ ràng là không chính xác, và tôi đã cười rất nhiều khi xem qua những câu hỏi kiểu này.

Mô hình DeepSeek-R1 chạy trên MacBook Air M1, hiển thị thông tin sai về iPhone đầu tiên

Mô hình DeepSeek-R1 chạy trên MacBook Air M1, hiển thị thông tin sai về iPhone đầu tiên

Nếu bạn đang nghĩ đến việc chạy LLM trên Raspberry Pi hoặc các phần cứng tiêu thụ điện năng thấp khác, bạn sẽ phải điều chỉnh kỳ vọng của mình thấp hơn nữa. Trong những trường hợp đó, bạn có thể sẽ bị giới hạn ở các mô hình nhỏ hơn nhiều với khoảng 1,5 tỷ tham số, chỉ có thể xử lý các truy vấn rất cơ bản.

Các mô hình đám mây như ChatGPT vẫn có lợi thế về khả năng thô. Chúng thường hỗ trợ các tính năng như tìm kiếm web và plugin, và giới hạn kiến thức của chúng thường cập nhật hơn. Trừ khi bạn có phần cứng nghiêm túc để chạy các mô hình lớn hơn nhiều cục bộ, việc đạt được trải nghiệm tương đương vẫn chưa thực tế vào thời điểm hiện tại.

Mô hình Vicuna-7B hoạt động trên Samsung Galaxy S23 Ultra, minh họa sức mạnh của AI trên thiết bị

Mô hình Vicuna-7B hoạt động trên Samsung Galaxy S23 Ultra, minh họa sức mạnh của AI trên thiết bị

Tóm lại, việc tự chạy LLM cục bộ mang lại sự riêng tư, kiểm soát và khả năng hoạt động ngoại tuyến vượt trội, đặc biệt hữu ích cho các tác vụ nhẹ và môi trường không có internet. Với các công cụ như Ollama và Open WebUI, quá trình thiết lập trở nên đơn giản hơn bao giờ hết, ngay cả trên phần cứng khiêm tốn như MacBook Air M1. Tuy nhiên, đối với các yêu cầu phức tạp, độ chính xác cao hoặc cần truy cập thông tin cập nhật, các mô hình đám mây vẫn giữ lợi thế.

Bạn đã từng thử chạy LLM cục bộ chưa? Trải nghiệm của bạn như thế nào? Hãy chia sẻ ý kiến và câu hỏi của bạn trong phần bình luận bên dưới, hoặc khám phá thêm các bài viết khác của chúng tôi về thế giới AI và công nghệ.